论文原文:Communication-Efficient Learning of Deep Networks from Decentralized Data

概述

在现代计算机科学中,机器学习被广泛应用于各种领域。然而,机器学习需要大量的数据才能达到最佳性能。在某些情况下,由于数据隐私和安全的原因,集中式训练模型可能不可行。这就是联邦学习的概念出现的原因。联邦学习是一种机器学习范式,其中模型在本地设备上训练,而不是在集中式服务器上训练。本篇博客将介绍一种常用的联邦学习算法——FedAvg。

FedAvg是一种常用的联邦学习算法,它通过加权平均来聚合模型参数。FedAvg的基本思想是将本地模型的参数上传到服务器,服务器计算所有模型参数的平均值,然后将这个平均值广播回所有本地设备。这个过程可以迭代多次,直到收敛。

为了保证模型聚合的准确性,FedAvg算法采用加权平均的方式进行模型聚合。具体来说,每个设备上传的模型参数将赋予一个权重,然后进行加权平均。设备上传的模型参数的权重是根据设备上的本地数据量大小进行赋值的,数据量越多的设备权重越大。

FedAvg的优势

与其他联邦学习算法相比,FedAvg有以下优点:

- 低通信开销:由于只需要上传本地模型参数,因此通信开销较低。

- 支持异质性数据:由于本地设备可以使用不同的数据集,因此FedAvg可以处理异质性数据。

- 泛化性强:FedAvg算法通过全局模型聚合,利用所有设备上的本地数据训练全局模型,从而提高了模型的精度和泛化性能。

FedAvg的缺点

尽管FedAvg具有许多优点,但它仍然存在一些缺点:

- 需要协调:由于需要协调多个本地设备的计算,因此FedAvg需要一个中心化的协调器来执行此任务。这可能会导致性能瓶颈或单点故障。

- 数据不平衡问题:在FedAvg算法中,每个设备上传的模型参数的权重是根据设备上的本地数据量大小进行赋值的。这种方式可能会导致数据不平衡的问题,即数据量较小的设备对全局模型的贡献较小,从而影响模型的泛化性能。

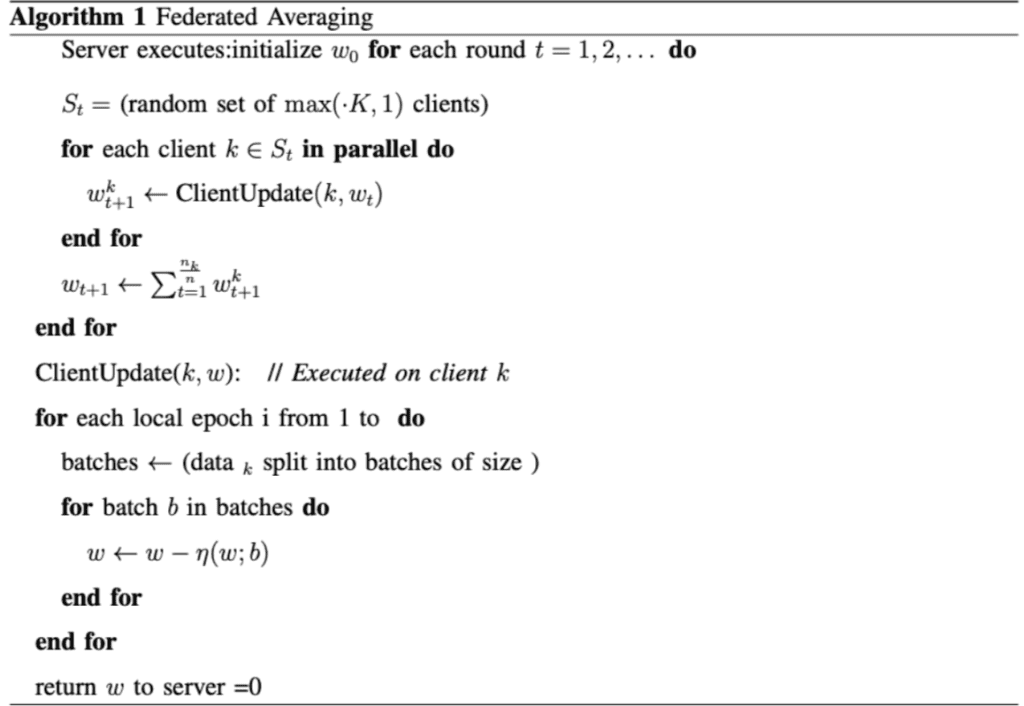

FedAvg的算法流程

伪代码

详解

- 服务器初始化全局模型参数 $w_0$;

- 所有本地设备随机选择一部分数据集,并在本地计算本地模型参数 $w_i$;

- 所有本地设备上传本地模型参数 $w_i$ 到服务器;

- 服务器计算所有本地模型参数的加权平均值 $\bar{w}$,并广播到所有本地设备;

- 所有本地设备采用 $\bar{w}$ 作为本地模型参数的初始值,重复步骤2~4,直到全局模型收敛。

代码实现 Code

def fedavg(self):

# FedAvg with weight

total_samples = sum(self.num_samples)

base = [0] * len(self.weights[0])

for i, client_weight in enumerate(self.weights):

total_samples += self.num_samples[i]

for j, v in enumerate(client_weight):

base[j] += (self.num_samples[i] / total_samples * v.astype(np.float64))

# Update the model

return base结论

总体来说,FedAvg算法是一种有效的联邦学习算法,能够在保护隐私数据的同时,利用本地数据训练全局模型,降低通信开销和支持分布式设备,同时提高模型的精度和泛化性能。随着联邦学习的发展和应用场景的不断扩大,FedAvg算法的研究和应用也将不断深入。未来,FedAvg算法有望在算法优化、隐私保护、模型压缩等方面得到进一步改进,并应用于更多的领域和场景中。

评论 (0)